Blockchain, Chatbots und KI: Die Trends im Überblick

Krieg der Chatbots

Die Entwickler von Chatbots haben inzwischen echt die Qual der Wahl: Über 100 Frameworks buhlen um die Gnade der Programmierer. Vom unscheinbaren Platzhirsch Wit.ai über Microsofts Bot Framework, die universelle Chatbot-Plattform API.ai mit Fähigkeiten zum maschinellen Lernen bis hin zur Python-Bibliothek ChatterBot – es findet sich etwas für (fast) alle Ansprüche. Ein Krieg der Chatbot-Plattformen und KI-Assistenten – angefangen von Apple Siri über Facebook Messenger/M, Google, Microsoft Cortana bis hin zum Schwergewicht Amazon Alexa – ist offenbar lediglich eine Frage der Zeit.

Die ersten kommerziellen Anwendungen von Chatbots waren vergleichsweise simpel gestrickt: Sie folgten einem vordefinierten Gesprächsablauf. Auch heute können die Benutzer eines Chatbots mithilfe der Anwendung Informationen vom automatisierten Kundendienst anfordern oder Bestellungen aufgeben, nicht jedoch einen philosophischen Diskurs führen. Weicht der Benutzer in seinen Anfragen vom Skript ab, zeigt sich ein Chatbot schon mal überfordert. Auch sind Chatbots weit davon entfernt, die Emotionen des Gegenübers oder Nuancen wie ironische Bemerkungen aus dem Kontext des Gesprächs ablesen zu können. In der Zukunft ist aber eine Menge mehr zu erwarten.

Training für die nötige Flexibilität

Für den Nutzer gibt es nahezu unzählige Möglichkeiten, die gewünschte Handlung des Chatbots anzufordern. Ein Chatbot sollte daher in der Lage sein, auch Anfragen mit alternativen Formulierungen korrekt zu interpretieren. Bei der Eingabe «Wo ist meine Bestellung?» und «Wann bekomme ich meine Bestellung?» handelt es sich im Grunde genommen um dieselbe Problemstellung: Der Kunde wartet auf sein Produkt. Um lebensechte alternative Formulierungen zu implementieren, sollten Chatbots anhand echter Daten trainiert werden. Diese Lernphase dürfte im Idealfall eigentlich niemals aufhören. Entwickler sind gut beraten, sich auch nach der Bereitstellung der Chatbot-Anwendung regelmässig durch Logs von Text-Chats durchzuhangeln, um zu ermitteln, wo es eventuell noch hapert.

Produktive Chatbots können zum Teil eigenständig weiterlernen, sofern sie mit einem passenden Interface ausgestattet sind. Meldet der Nutzer etwa «Mir fehlt die Wasserpumpenzange», könnte ein Chatbot, der mit der Zange in Kombination mit einer Bestellung nichts anzufangen weiss, den Ausnahmezustand wie folgt handhaben:

Bitte Zutreffendes eingeben (A, B oder C):

- A: Ihr Paket ist verloren gegangen oder wurde beschädigt bzw. nicht vollständig zugestellt.

- B: Sie haben die Rechnung nicht erhalten.

- C: Sie möchten mit einem unserer Mitarbeiter chatten.

Aus der Antwort des Nutzers (A, B oder C) kann der Chatbot lernen, was es mit der Wasserpumpenzange im Kontext der Bestellung auf sich hat.

Doch damit hat sich die Sache noch lange nicht erledigt. Denn böswillige Nutzer könnten dem System leicht Unsinn antrainieren. Allein aus diesem Grund ist es zwingend notwendig, lernenden Chatbots auch Grenzen zu setzen und den Ablauf echter Chats mithilfe der Logs durch Menschen beaufsichtigen zu lassen. Im Endeffekt nutzen Chatbots idealerweise mehrere Methoden der Klassifizierung von Anfragen, und zwar:

- Erkennung von Übereinstimmungen der Benutzereingabe mit Vorlagen,

- erweiterte Mustererkennung durch Algorithmen und

- heuristische Entscheidungsfindung, typischerweise mithilfe (lernender) künstlicher neuronaler Netze.

Bei der Mustererkennung anhand von Vorlagen genügt bereits eine alternative Schreibweise oder Zusammenstellung der Worte, um den Chatbot ausser Gefecht zu setzen. Erweiterte Mustererkennung durch Algorithmen kann hier Abhilfe schaffen. Ein solcher Algorithmus ist der NLP- und Textklassifizierungsklassiker Multinational Naive Bayes, ein überwachter Lernalgorithmus auf der Grundlage von Bayes Theorem mit der naiven Annahme der Unabhängigkeit zwischen jedem Paar von Merkmalen.

Der Chatbot klassifiziert die Anfrage auf der Basis errechneter Wahrscheinlichkeiten, die sich aus starren Vorgaben des eingesetzten Modells ableiten lassen. Diese Methode erweitert das Verständnis des Bots, kann allerdings weder einen Volltreffer garantieren noch dazulernen.

Damit das eingesetzte Modell dynamisch lernen kann, müssen Chatbot-Entwickler tiefer in die Trickkiste greifen. Immer öfter kommen hierbei künstliche neuronale Netze zum Einsatz. Durch eine ausgiebige Trainingsphase zur Ermittlung der optimalen Gewichtung der künstlichen Synapsen lässt sich die Genauigkeit der Klassifizierung einer Anfrage durch den Chatbot wesentlich erhöhen.

Vorabdiagnose per Chatbot

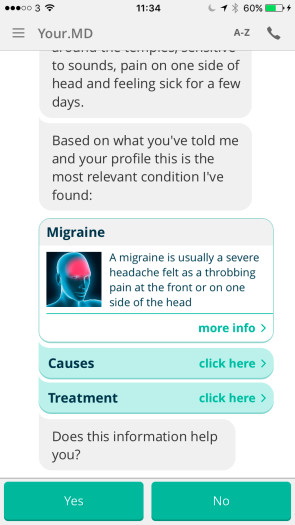

Einen kleinen Vorgeschmack auf die Fähigkeiten künftiger Chatbots gibt die App Your.MD. Sie nutzt künstliche Intelligenz – konkret ein proprietäres künstliches neuronales Netz, Maschinelles Lernen (ML) und Natural Language Processing (NLP) – in Kombination mit menschlicher Intelligenz, indem es ab und zu auch echte Ärzte zurate zieht. Benutzer der App können mit dem Chatbot über ihre Gesundheit plaudern, um kostenfrei eine Vorabdiagnose ihrer Symptome zu erhalten und auf mögliche Ursachen ihrer Gesundheitsprobleme sensibilisiert zu werden. Der Chatbot ist sowohl im Web als auch als App für Android und iOS, eine Erweiterung für Facebook Messenger, Skype, Slack und Telegram verfügbar sowie mittlerweile für mehr als 60 Prozent der Weltbevölkerung zugänglich. Your.MD rühmt sich einer Million aktiver Benutzer, denen das System eine «medizinisch zertifizierte Beratung» gewährleisten möchte. Und das ohne den Zugang zu einem Mediziner, via reiner Ferndiagnose per KI-Chatbot. Das Beispiel mag zwar nicht gerade ein erstrebenswertes Modell der Krankenversorgung repräsentieren, aber es illustriert eindrücklich die Fähigkeiten von künstlicher Intelligenz (KI).