Hintergrund

04.12.2019, 15:30 Uhr

Ethik für Maschinen: Befehl verweigert? Test bestanden!

Handeln Systeme mit künstlicher Intelligenz autonom, kann das gehörig schiefgehen. Um dem vorzubeugen, braucht es eine Maschinenethik. Diese soll Roboter mit einer Form der Befehlsverweigerung vertraut machen, die moralisch begründet ist.

Damit intelligente Maschinen und Menschen partnerschaftlich zusammenarbeiten können, müssen im Vorfeld ethische Fragen diskutiert und geklärt werden. Auf den Antworten werden künftig Richtlinien etwa für einen Roboter-TÜV aufbauen

(Quelle: Shutterstock / Willyam Bradberry)

Wie kann man die Entscheidungen eines autonom handelnden Roboters, der mit künstlicher Intelligenz (KI) ausgestattet ist, so steuern, dass dessen Entscheidungen ethisch vertretbar sind? In der aktuellen Diskussion um künstliche Intelligenz gehen die Meinungen darüber auseinander, was darunter eigentlich zu verstehen sei. An den Beginn möchte ich daher eine Definition von künstlicher Intelligenz setzen. Ich schliesse mich der Definition an, die Max Tegmark, Physikprofessor am MIT, in seinem Buch «Leben 3.0» vorschlägt. Auf Seite 80 des Buches definiert er Intelligenz zunächst als die «Fähigkeit, komplexe Ziele zu erreichen». Anwendungen der künstlichen Intelligenz bieten dementsprechend Werkzeuge, mit denen sich komplexe Ziele erreichen lassen.

KI als erweiterter Schraubenzieher

Aus der Definition resultiert zunächst: KI ist ein Werkzeug. So ähnlich wie ein Schraubenzieher. Wer als Ziel hat, eine Schraube zu entfernen, nimmt als Werkzeug einen Schraubendreher. Dieser eignet sich also für ein einzelnes, sehr spezielles Ziel. Wer ein komplexes Ziel hat, verwendet Anwendungen der künstlichen Intelligenz.

Komplexe Ziele können etwa sein: Analysiere ein Röntgenbild. Formuliere zu einem Foto eine passende Bildbeschreibung in finnischer Sprache. Verabreiche einem Patienten das erforderliche Medikament. Vermiete meine Wohnung. Finde den passenden Bewerber für die offene Stelle. Handle mit meinen Aktien. Finde einen Lebenspartner für mich. Mach mich reich. Mach mich glücklich. Komplexe Ziele können aber auch sein: Finde den Menschen, von dem ich dir jetzt drei Fotos zeige, und bringe ihn um. Streue in den sozialen Netzwerken üble Verleumdungen zu allen Personen, die der Partei XYZ nahestehen. Töte alle meine Feinde.

An welcher Stelle kommt hier nun die Maschinenethik ins Spiel? Schraubenzieher und KI sind gleichermassen Werkzeuge. Ist ein Schraubendreher gut oder böse? Vielleicht gut, denn er kann ja Schrauben drehen, und das ist kreative Handwerksarbeit. Oder böse, denn jemand hat seinem Chef mit einem Schraubenzieher auf den Kopf gehauen. Natürlich weder noch, weil ein Werkzeug an sich weder gut noch böse ist. Die Handlung, die jemand mit einem Werkzeug ausführt, kann gut oder böse sein, aber nicht das Werkzeug selbst.

Das führt zu folgender Erkenntnis: Weil KI auch nur ein Werkzeug ist, lässt sie sich sowohl für gute Zwecke («Heile diese Krankheit») als auch für übelste Verbrechen einsetzen. Diese Erkenntnis mag trivial erscheinen. Sie ist es aber nicht. In der öffentlichen Diskussion werden dem Werkzeug KI oft genug auch moralische Eigenschaften zugeschrieben, die der KI einfach nicht zukommen. Da wird schon mal darum geworben, man möge doch «Vertrauen in künstliche Intelligenz» haben. Appelle dieser Art sind ungefähr so sinnvoll wie: Habt Vertrauen in Schraubenzieher! In Backöfen! In Maschinengewehre! Denn das sind doch alles gute Sachen, oder etwa nicht?

Hier ist offensichtlich nicht das Einsatzgebiet der Maschinenethik. Hier ist das Einsatzgebiet der Ethik. Hier muss sich der Mensch fragen: Darf ich dieses oder jenes tun oder lassen? Darf ich dieses oder jenes komplexe Ziel überhaupt verfolgen? Fragen dieser Art werden bereits seit Jahrtausenden in allen Weltkulturen intensiv und kontrovers diskutiert.

Schraubendreher mit eigenem Willen

Es wurde behauptet: Ein Werkzeug kann an sich weder gut noch böse sein, sondern nur der Verwendungszweck. Trifft das auch auf KI wirklich zu? Wenn man Leuten zuhört, die mit KI arbeiten, trifft man immer wieder auf Erzählungen, in denen es um den Eigenwillen, und speziell den völlig unvorhergesehenen Eigenwillen von KI geht. Und es geht darum, dass die Entwickler selbst von diesem Phänomen überrascht wurden. Entwickler denken ja immer, sie würden der Maschine sagen, was sie tun soll. Wenn die Maschine das ausführt, was der Entwickler ihr gesagt hat, dann ist der Entwickler stolz. Aber nun macht die Maschine auf einmal etwas, was der Entwickler ihr gerade eben nicht gesagt hat. Was aber anscheinend doch irgendwie der Zielerreichung dient. Und jetzt ist der Entwickler erst einmal platt. Und dann wird ihm leicht mulmig. Anscheinend muss man das erlebt haben. Erst dann kann die Idee aufkommen, dass so etwas wie Maschinenethik vielleicht nützlich sein könnte. Auch ganz im eigenen Interesse. Hier zunächst Beispiele eigenwilliger Maschinen. Erst mal eins zum Lachen.

Entwickler müssen leider draussen bleiben

Jürgen Schmidhuber entwickelt am Schweizer Labor IDSIA lernende neuronale Netze. In einem Interview wurde er gefragt: «Was geschieht, wenn die Maschinen eines Tages merken, dass es rationaler wäre, nicht mehr von Menschen gesetzten Regeln, sondern ihren eigenen zu folgen?» Seine Antwort lautete: «Das ist schon längst passiert. Mein Kollege Mike Mozer baute in den 1990ern ein ‹neuronales› Haus, das alle Geräte im Haus steuerte und lernte, Energie zu sparen, beispielsweise durch Rollläden statt Klimaanlage, wenn es zu heiss war. Wenn das Haus etwas tat, das Mike nicht behagte, konnte er es durch einen Knopf bestrafen. Das Haus fand einen Weg, dieser Bestrafung zu entgehen: Als er mal weg war, sperrte es ihn aus» [1]. Das System sperrt seinen eigenen Schöpfer aus – aus Sicht der Maschine kann das vernünftig sein. Aber will man sich darauf einlassen?

Ein weiteres Beispiel: Max Tegmark schreibt in seinem Buch «Leben 3.0» auf Seite 126: «Stuart Russell erzählte mir, dass er und viele seiner Kollegen in der KI-Forschung kürzlich einen Moment erlebten, der ihnen den Ausruf ‹Heilige Scheisse!› entlockte: Sie wurden Zeugen, wie KI etwas tat, das sie in dieser Form erst sehr viel später erwartet hatten.»

Als Beispiel dafür nennt er den Moment, als das KI-System AlphaGo von Google DeepMind im Jahr 2016 Lee Sedol, den weltbesten Go-Spieler, schlug. Interessant ist, wie dem System dieser Gewinn gelang. Entscheidend war ein bestimmter Zug, den alle Beteiligten als revolutionär ansahen. Tegmark erläutert, dass Züge auf der dritten Linie des Go-Spielbretts traditionell einen kurzfristigen taktischen Vorteil bieten und Züge auf der vierten Linie einen längerfristigen strategischen Vorteil. Er berichtet: «Im 37. Zug des zweiten Spiels schockierte AlphaGo die Go-Welt, indem er diese alte Weisheit ignorierte und auf der fünften Linie spielte, als sei er in seiner Fähigkeit, langfristig zu planen, sogar noch souveräner als ein Mensch. [...] Die Kommentatoren waren verblüfft, Lee Sedol stand sogar auf und verliess vorübergehend den Raum.» Und dieser allseits unvorhergesehene Zug führte schliesslich zum Sieg von AlphaGo gegen den Weltmeister im Go-Spiel.

Go ist nur ein Spiel: Wie die Maschine spielt, hat weiter keinen Einfluss auf das Weltgeschehen. Problematisch wird es dann, wenn man Maschinen nicht nur rechnen, sondern auch nach ihren eigenen Berechnungen handeln lässt.

Buchtipp

Leben 3.0

Zum Einstieg präsentiert der Autor Max Tegmark auf 25 Seiten eine Story von einer Firma, die eine allgemeine KI erstellt, diese heimlich nutzt und sich so nach und nach die Weltherrschaft aneignet. Der Witz an dieser Story ist: Jeder Schritt ist nachvollziehbar. Und am Ende der Geschichte fragt man sich nicht mehr, ob es so weit kommen kann, sondern eigentlich nur noch, wann es so weit sein wird. Tegmark ist ein nüchterner Wissenschaftler. Nach dem visionären Einstieg räumt er mit vielen Mythen auf und setzt Erkenntnisse daneben.

Max Tegmark: Leben 3.0. Ullstein 2019; ISBN 978-3-548-377964

Weniger Bettler = weniger Armut

Man könnte ein System der künstlichen Intelligenz zum Beispiel fragen: «Wie können wir Armut bekämpfen?» Ein KI-System, das von keiner Maschinenethik gebändigt wird, könnte antworten: «Tötet alle Bettler!» Mathematisch ergibt das Sinn: Wenn man alle Bettler umbringt, gibt es keine mehr – Ziel erreicht. Ethisch ist der Vorschlag unvertretbar.

Aber wie kann man sicherstellen, dass eine autonom handelnde Maschine auch nur ethisch vertretbare Handlungen ausführt? Wie implementiert man Maschinenethik? Fragen wir doch einfach mal Unternehmen, die Roboter herstellen. Die müssen das doch wissen. Das Fraunhofer-Institut für Produktionstechnik und Automatisierung IPA in Stuttgart entwickelt den Serviceroboter Care-O-bot. Auf der Website zum Care-O-bot heisst es: «Forscher haben ein neues Modell eines universellen Helfers entwickelt: die vierte Generation des Care-O-bot. Sie kann als Basis für kommerzielle Serviceroboter-Lösungen dienen.»

Wie implementiert dieser Care-O-bot ethisch korrektes Verhalten? Auf eine entsprechende Anfrage antwortet die promovierte Wissenschaftlerin Katrin Röhricht vom Fraunhofer-Institut: «Ethische Themen spielen bei uns natürlich immer mit in die Entwicklung der Roboter hinein, allerdings sind wir alles andere als Experten auf diesem Gebiet. Aktuelle Systeme, die hier entstehen, sind auch technisch nicht so weit, dass hier tatsächlich ethisches Verhalten implementierbar wäre.» Beim Fraunhofer-Institut scheint man eher schon froh zu sein, wenn der Roboter nicht umfällt, wenn er eine Last transportiert. Zu ethischen Fragestellungen verweist Röhricht auf das EU-Projekt Reeler. Bei diesem Projekt werden ethische Aspekte des Robotereinsatzes diskutiert. Es geht etwa darum, wie Arbeitnehmer davon betroffen sind. Aber es geht nicht darum, Maschinenethik in Roboter zu implementieren.

Robot Operating System

Das Betriebssystem des Care-O-bot ist die Open-Source-Software Robot Operating System. Auf deren Website heisst es: «Robot Operating System (ROS) provides libraries and tools to help software developers create robot applications. It provides hardware abstraction, device drivers, libraries, visualizers, message-passing, package management, and more. ROS is licensed under an open source, BSD license.» Ist darin auch ein Modul für Maschinenethik enthalten? Eine entsprechende Anfrage in der Diskussionsgruppe war zwar gelesen worden, blieb aber bis Redaktionsschluss leider ohne Antwort. Also wieder nix.

Auch weitere Recherchen führen zu keinem Ergebnis. Eine konkrete Implementation von Maschinenethik ist einfach nicht aufzutreiben. Das macht aber nichts. Im Gegenteil. Ich finde das ausgezeichnet. Denn es gibt mir die gute Gelegenheit, für die Implementierung von Maschinenethik einen eigenen Entwurf zu entwickeln und hier vorzustellen.

Buchtipp

Grundfragen der Maschinenethik

Die Philosophieprofessorin Catrin Misselhorn liefert mit ihrem Sachbuch ein Grundlagenwerk zum Thema Maschinenethik. Der Reclam-Band bietet nahrhaftes Schwarzbrot zu einem Thema, bei dem andere Autoren nur geschlagenen Schaum anzubieten haben. Wer als IT-Fachkraft bislang noch nie etwas mit Philosophie zu tun hatte, möge sich einmal an diesem Buch versuchen. Die begriffliche Trennschärfe und argumentative Ruhe, mit der Misselhorn das aktuelle Thema durchdringt, tut einer Diskussion gut, in der Erkenntnisse, Meinungen und Emotionen sonst oft wild durcheinandergehen.

Catrin Misselhorn: Grundfragen der Maschinenethik. Reclam; ISBN 978-3-15-019583-3

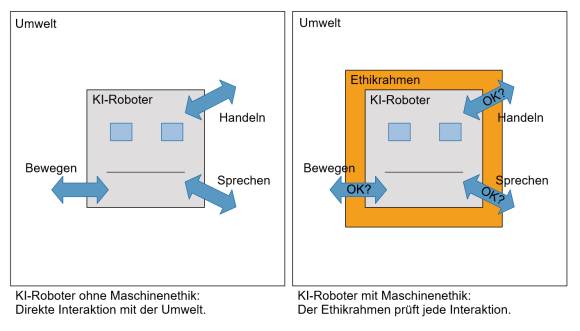

Das dörfsch du nöd

Gesagt, getan: Im Bild unten zeigt der linke Bereich zunächst einen KI-Roboter ohne Maschinenethik. Das innere Feld deckt alles ab, was der Roboter kann. Um das innere Feld herum erstreckt sich die äussere Welt. Ohne implementierte Maschinenethik interagiert der Roboter direkt mit der äusseren Welt. Zur Implementierung von Maschinenethik ziehe ich um das innere Feld einen Ethikrahmen, wie er im Bild auf der rechten Seite zu sehen ist. Wann immer der Roboter jetzt mit der äusseren Welt interagieren will, muss die beabsichtigte Aktion zunächst den Ethikrahmen passieren. Dieser prüft jede beabsichtigte Aktion daraufhin, ob sie okay ist oder nicht, und lässt diese Aktion dann zu oder verhindert sie.

Nicht alle Funktionen des Systems müssen diesen Ethikrahmen passieren. Davon ausgenommen sind zum Beispiel maschinennahe Funktionen, die sich nur innerhalb des Systems abspielen und die keine Auswirkungen auf die Aussenwelt haben. Der Taktgeber des Hauptprozessors des Systems darf beispielsweise einen Takt geben, ohne dafür erst um Erlaubnis fragen zu müssen. Auf diese Weise lähmt der Ethikrahmen nicht die Aktivität des Systems, sondern er prüft nur solche Aktivitäten, die eine Auswirkung auf die Umwelt haben. Aber es ist offensichtlich: Wenn jede Interaktion mit der Aussenwelt erst den Ethikrahmen passieren muss, dann gibt es hier sehr viel zu tun. Jeder beabsichtigte Schritt, jede beabsichtigte Bewegung muss erst zugelassen werden. Gleichzeitig muss der Roboter den aktuellen Stand seiner Umwelt kontinuierlich beobachten und mit seinen beabsichtigten Handlungen abstimmen.

Viele Systeme, ein Ethikrahmen

Wenn man längere Zeit auf diesen simplen Entwurf blickt, fällt einem irgendwann Folgendes auf: Für das innere Feld, das für den jeweiligen Roboter steht, wird es x verschiedene Systeme von y verschiedenen Herstellern geben. Der Ethikrahmen kann und muss aber für alle Systeme identisch sein. Jedenfalls in gewissen Grenzen. Beispielsweise in den Grenzen eines Staates. Wer kreiert diesen Ethikrahmen? Diesen zu entwickeln umfasst drei Schritte:

- Schritt 1: Inhalte definieren.

- Schritt 2: Inhalte implementieren.

- Schritt 3: Testen, ob die Inhalte des Ethikrahmens auch korrekt implementiert worden sind.

Schritt 1: Hier vertrete ich einen pragmatischen Ansatz und sage: Den Inhalt des Ethikrahmens muss man nicht erst entwickeln, der existiert bereits. Die Gesamtheit aller geltenden Gesetze und Verordnungen bildet den Inhalt des Ethikrahmens für einen bestimmten Staat. Diese geben vor, was erlaubt und was verboten ist.

Schritt 2: Die eigentliche Implementierung können beliebige ICT-Firmen für die Entwicklung und den Bau ihrer KI-Systeme übernehmen.

Schritt 3: Tests auf korrekte Implementierung werden die IT-Hersteller und sonstige Technologieanbieter vornehmen. Andererseits wird der Staat Tests vorschreiben. In Folge dürfte eine Art Roboter-TÜV entstehen.

Isaac Asimov im Europäischen Parlament

In der Politik ist man sich längst der Tatsache bewusst, dass hier staatliches Handeln erforderlich ist. Als Beispiel sei auf einen Entschluss des Europäischen Parlaments verwiesen, der «Zivilrechtliche Regelungen im Bereich Robotik» behandelt. Die Entschliessung geht aus von der «Erwägung, dass die Menschheit mittlerweile an der Schwelle einer Ära steht, in der immer ausgeklügeltere Roboter, Bots, Androiden und sonstige Manifestationen künstlicher Intelligenz anscheinend nur darauf warten, eine neue industrielle Revolution zu entfesseln, die wahrscheinlich keine Gesellschaftsschicht unberührt lassen wird, und es daher für Gesetzgeber von entscheidender Bedeutung ist, sich mit den rechtlichen und ethischen Implikationen und Folgen dieser Entwicklung zu befassen, ohne Innovationen abzuwürgen».

Der Text ist nicht nur auf der Höhe der Zeit. Er ist aufgrund seines breiten Ansatzes auch äusserst interessant zu lesen. In der Einleitung bezieht sich der Entschluss unter Punkt T auf die Robotergesetze von Science-Fiction-Autor Isaac Asimov. Diese lauten:

- Ein Roboter darf kein menschliches Wesen verletzen oder durch Untätigkeit zulassen, dass einem menschlichen Wesen Schaden zugefügt wird.

- Ein Roboter muss den ihm von einem Menschen gegebenen Befehlen gehorchen – es sei denn, ein solcher Befehl würde mit Regel eins kollidieren.

- Ein Roboter muss seine Existenz beschützen, solange dieser Schutz nicht mit Regel eins oder zwei kollidiert.

Vorschläge des Beschlusses des EU-Parlaments sind etwa:

- Einführung eines EU-Registrierungssystems für fortschrittliche Roboter im Rahmen des EU-Binnenmarkts.

- Grundsatz der Transparenz: Entscheide, die ein KI-System getroffen hat, sollen nachzuvollziehbar sein.

- Ausstattung mit einer Blackbox, die alle Tätigkeiten des Roboters protokolliert, ähnlich wie in einem Flugzeug.

- Die Errichtung einer Europäischen Agentur für Robotik und künstliche Intelligenz.

- Einführung eines Versicherungssystems für Roboter, möglicherweise verknüpft mit einem speziellen rechtlichen Status für Robotersysteme, über den sich eventuelle Haftungsfragen klären lassen.

Angeklagt: Roboter 08/15

Solche Haftungsfragen stehen im Mittelpunkt des Beschlusses: Denn wenn Maschinen selbstständig entscheiden und danach handeln, wer haftet dann für einen eventuellen Schaden? Bevor derartige Fragestellungen nicht abschliessend geklärt sind, ist eine wirtschaftliche Nutzung von Robotern auf breiter Basis so gut wie ausgeschlossen. Im Hintergrund dieser Entschliessung dürfte die Automobilindustrie kräftig mitgearbeitet haben. Denn in dieser Branche besteht momentan das grösste Interesse daran, autonom agierende Maschinen auf die Menschheit loszulassen. Die Überlegungen in der Entschliessung gehen beispielsweise so weit, sogar eine eigene Art von juristischer Person für autonome Roboter zu erfinden.

Diese Art von juristischer Person wäre natürlich ein reines juristisches Konstrukt. Es würde gar nichts darüber aussagen, ob der Roboter eine echte «Person» ist. Natürlich ist er es nicht, so wenig wie eine GmbH eine Person ist. Aber für juristische Zwecke wäre es praktisch. Man könnte dann beispielsweise alle juristischen Personen dieser Art dazu verpflichten, sich bei einer speziellen Behörde zu registrieren, sich speziell zu versichern und so weiter. Was die Tests auf korrekte Implementierung des Ethikrahmens betrifft, kann man nahtlos an bestehende Regelungen anknüpfen. Die Maschinenrichtlinie der EU schreibt beispielsweise vor, dass man für jede Maschine, die jemand in der EU in Verkehr bringt, zunächst eine Risikobeurteilung erstellen muss. Anschliessend soll die Maschine entsprechend den Erkenntnissen aus dieser Risikobeurteilung konstruiert und gebaut werden.

Übrigens, in der Anlage zur erwähnten EU-Entschliessung befindet sich ebenfalls ein «Ethischer Verhaltenskodex für Robotikingenieure». Dieser enthält dementsprechend auch diesen Satz: «Der Betrieb eines Robotiksystems sollte grundsätzlich auf eine umfassende Risikobeurteilung gestützt werden, die auf den Grundsätzen der Vorsorge und der Verhältnismässigkeit beruhen sollte.» Und wie man solche Risikobeurteilungen vornimmt und die Umsetzung empfohlener Schutzmassnahmen im Rahmen von Akzeptanztests prüft, das gehört zum Repertoire jedes Maschinenbauingenieurs, sollte es jedenfalls.

Befehlsverweigerung als Roboterpflicht

Den Artikel möchte ich mit einem Zitat von Oliver Bendel abschliessen. Bendel ist Professor am Institut für Wirtschaftsinformatik und Ethik an der Fachhochschule Nordwestschweiz. In seinem Beitrag «Überlegungen zur Disziplin der Maschinenethik» schreibt er unter anderem über Pflegeroboter. Bendel diskutiert hier das Problem, dass Pflegeroboter im Prinzip in der Lage sein könnten, einen Patienten zu töten, und betont: «Wer das für Science-Fiction hält, sollte sich unterschiedliche Typen von Pflegerobotern anschauen. Solche, die etwas transportieren, solche, die uns informieren, und solche, die Hand an uns legen. Manche sehen aus wie ein Mensch oder ein Tier, andere wie Kooperations- und Kollaborationsroboter aus der Industrie. Diese haben meist einen Arm, mehrere Achsen und zwei bis drei Finger. Man kann sie trainieren, indem man ihren Arm und ihre Finger bewegt oder ihnen einfach etwas vormacht, während sie mit ihren Sensoren und Systemen alles verfolgen und verarbeiten. Im Prinzip kann man ihnen beibringen, uns zu erwürgen [...]. Eine Aufgabe der Maschinenethik wäre es eben, den Roboter mit einer Form der Befehlsverweigerung vertraut zu machen, die moralisch begründet wäre.»

Kleines Maschinenethik-Glossar

Trolley Case: Der klassische Fall einer Dilemma-Situation. Dieses Gedankenexperiment gibt es in verschiedenen Varianten. Es wurde ursprünglich von der Philosophin Philippa Foot (1920–2010) erdacht. Eine Variante hat diese Form: Angenommen, eine Strassenbahn (englisch: trolley) ist ausser Kontrolle geraten und droht, fünf Leute zu überfahren. Ein unbeteiligter Mann steht neben der Bahn. Wenn man diesen Mann vor die Bahn schubsen würde, dann würde die Bahn gestoppt, der Mann wäre tot, aber die fünf Leute wären gerettet. Wäre das erlaubt?

Utilitarismus: Jeremy Bentham (1748–1832) und John Stuart Mill (1806–1873) gelten als geistige Väter des Utilitarismus. Bentham brachte die Grundidee auf den Punkt mit dem Slogan: «Das grösste Glück der grössten Zahl ist der Massstab für richtig und falsch.» In dem oben genannten Trolley Case müssten Utilitaristen den Mann auf die Gleise schubsen, denn dann stirbt nur einer und fünf überleben.

Moralphilosophie nach Immanuel Kant: Gegenspieler zum Utilitarismus. Für Kant ist der gute Wille allein entscheidend, nicht die Folgen der Handlung. Kants kategorischer Imperativ sieht vor, dass die Grundsätze, nach denen jemand handelt, stets auch die Grundlagen einer Gesetzgebung sein könnten. Menschen dürfen niemals nur als Mittel zum Zweck verwendet werden. Nach Kant darf man den Mann nicht auf die Gleise schubsen, denn ein Mensch darf nicht als Mittel zum Zweck verwendet werden.

Tugendethik: Vielschichtige Strömung, die aus der Antike stammt. Im Zentrum steht die charakterliche Bildung der einzelnen Person und die Einbettung dieses Verhaltens in die jeweilige Gesellschaft. Die Tugendethik ist weniger gut geeignet für das Herausbilden allgemein gültiger Grundsätze. Sie hat keine klare Meinung zum Trolley Case.

Singularität: Spekulative Vorstellung einer «Intelligenzexplosion». Diese soll sich ab dem Umschlagpunkt abspielen, ab dem Maschinen intelligenter als Menschen sind und in Eigenregie immer noch intelligentere Maschinen entwickeln könnten. In deren Folge könnte eine sogenannte Hyper-Intelligenz entstehen, die am Ende sogar die Weltherrschaft übernimmt.