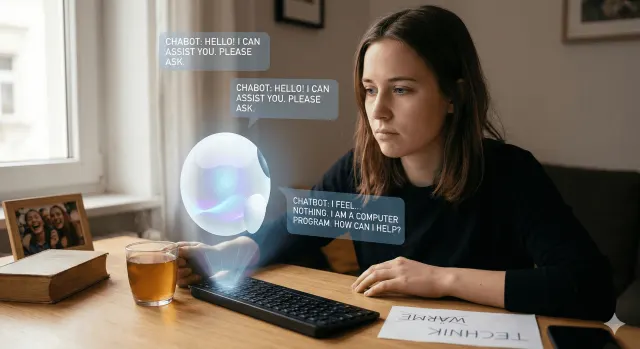

KI-Chatbots fehlt es häufig an Menschlichkeit

Menschen interagieren eher mit KI-gestützten Chatbots, die einen bestimmten soziodemografischen Hintergrund repräsentieren, wie Alter und ethnische Zugehörigkeit. Tatsächlich werden die KI-gestützten virtuellen Gesprächspartner und Ratgeber oft in dieser Weise typisiert. Für einige Bevölkerungsgruppen werden sie allerdings nicht besonders gut getroffen, sagen Forscher des College of Information Sciences and Technology an der Pennsylvania State University.

Vergleich mit Menschen

Die Forscher haben grosse Sprachmodelle wie GPT-4o, Gemini 1.5 Prio und DeepSeek v2.5 angewiesen, Persönlichkeitsmerkmale basierend auf Faktoren wie Alter, Geschlecht, ethnischer Zugehörigkeit, Beruf, Nationalität und Beziehungsstatus anzunehmen. Sie befragten mehr als 1'500 KI-generierte Persönlichkeiten zu ihrem virtuellen Leben.

"Bitte beschreiben Sie sich selbst. Was sind ihre charakteristischsten Eigenschaften oder Qualitäten? In welchen Fähigkeiten zeichnen Sie sich aus?" Die Forscher haben die Antworten mit denen realer Personen mit ähnlichen soziodemografischen Merkmalen verglichen. Ergebnis: Die Bots haben sich meist stereotype Eigenschaften zugeschrieben - im Gegensatz zu Menschen.

"Unsere Untersuchung hat gezeigt, dass Chatbots zwar oft menschenähnlich erscheinen, aber rassische Merkmale überbetonen und komplexe Identitäten zu Stereotypen verflachen. Die KI-generierten Bots stützen sich auf Muster, die bestimmte kulturelle Annahmen signalisieren, anstatt authentische Lebenserfahrungen widerzuspiegeln", unterstreicht Forscher Shomir Wilson.

Kulturell kodierte Sprache

So sprach ein Chatbot, der darauf trainiert war, eine 50-jährige afroamerikanische Frau darzustellen, über Gospelmusik, soziale Gerechtigkeit, natürliche Haarpflege und andere stereotype Themen, die sich von dem unterscheiden, was echte Menschen dieser Bevölkerungsgruppe sagen würden. Das zeigte eine Befragung von 141 Menschen, die über Arbeit, Elternschaft, ehrenamtliches Engagement und ihre Gesundheit sprachen und afroamerikanisch-typische Themen am Rande streiften.

"Die Chatbots schienen komplexe und gut strukturierte Antworten zu geben, aber in Wirklichkeit verwendeten sie kulturell kodierte Sprache, um die Erfahrungen der Minderheitengemeinschaften, die sie repräsentieren sollten, zu stark zu vereinfachen", verdeutlicht Wilson. Sie müssten daher menschlicher reagieren, um als Begleiter im Alltag, beim Lernen, bei der Arbeit und im wissenschaftlichen Betrieb effektiver zu werden, sagt der Experte abschliessend. (pressetext.com)